Ну что, начнем? Итак, ваш блог стремительно набирает популярность, а системы поиска все лучше и лучше его индексируют. Вот в этот момент все и начинают задумываться о том, чтобы в индексацию поисковиков попадали лишь нужные вам страницы вашего блога без различного мусора и повторяющегося контента.

Довольно часто случается так, что в результаты поиска попадают две совершенно разные страницы, хотя содержание этих самых страниц идентичное. Естественно поисковыми системами это очень даже не приветствуется.

В первую очередь приведем список ботов самых популярных и распространенных поисковых систем, а точнее их имена:

YANDEX — Яндекс

GOOGLE — Гугл

Прочитав, и вникнув текст данной статьи вы обязательно поймёте для чего предназначена данная расшифровка. В первую очередь важно осознать то, что при составлении файла robots.txt для поиска Яндекса необходимо прописывать «yandex», ну а для Гугла соответственно писать «google».

Файл robots.txt как это работает.

Допустим, вы не желаете чтоб та или иная поисковая система видела ваш блог. Значит в строке

User-agent:

необходимо указать лишь интересующий вас поисковик.

Если вы оставите так

User-agent: *

то правила приведенные ниже, будут распространятся на все поисковики.

Строка

Disallow: /wp-admin/

способна закрыть от индексирования все элементы папки /wp-admin/, а говоря простым языком то все URL’ы в начале которых присутствует /wp-admin/.

Также можно указать определенные параметры для поисковых систем, таких как Гугл и Яндекс, которые будут постоянно напоминать системе о сайте, который индексируется.

Host: fin-dolg.ru

Можно указать даже расположение xml карты вашего сайта.

Ну вот и готов наш файл следующего содержания:

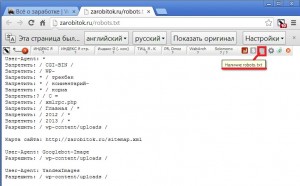

Просмотреть, как у кого составлен данный файл можно с помощью плагина RDS bar для браузеров, как показано на скриншоте.

На это все, удачи.

FastTrust

FastTrust

Адреса NS - сервера для чего они нужны

Адреса NS - сервера для чего они нужны Доходный email-маркетинг

Доходный email-маркетинг Ссылочные факторы ранжирования

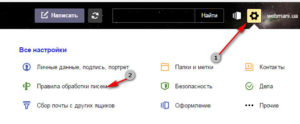

Ссылочные факторы ранжирования Пересылка почты Яндекс на другой почтовый ящик

Пересылка почты Яндекс на другой почтовый ящик

Надо взять на заметку